Nature:是时候该管一管AI情绪识别的泛滥

2021-04-08 MedSci原创 MedSci原创

不能再允许情绪识别技术不受监管。现在应该采取立法保护措施,防止在教育、保健、就业和刑事司法等所有领域未经证实地使用这些工具。

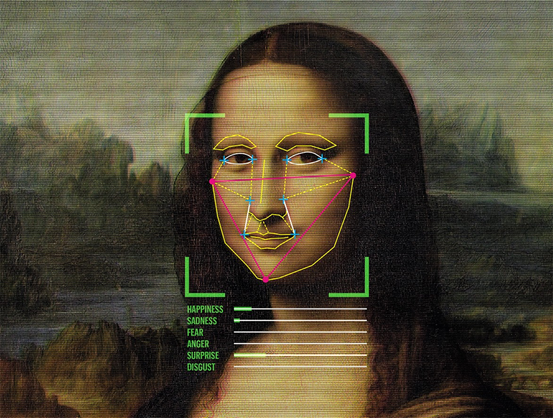

在流感大流行期间,科技公司一直在推销他们的情绪识别软件,用于远程监控员工甚至儿童。以一个名为“4棵小树”的系统为例。该项目在香港开发,声称可以评估孩子们在课堂作业时的情绪。它将每个学生的面部特征划分为快乐、悲伤、愤怒、厌恶、惊讶和恐惧等情绪状态。它还衡量“动机”和预测等级。类似的工具已经上市,为远程工作者提供监控。据估计,到2026年,情感识别行业将增长到370亿美元。

对于人工智能是否能够检测情感,科学界存在严重分歧。2019年的一项审查没有发现可靠的证据。该研究认为科技公司提出的问题很可能是根本错误的。

科学上越来越关注这些技术的使用和滥用。学者们呼吁对所有用于招聘的人工智能技术进行强制性、严格的审计,并公开披露调查结果。有组织呼吁应该成立一个独立的法律机构来监督生物识别技术的发展和实施。这种监督对于抵御颅相学冲动驱动的系统至关重要。颅相学冲动是指从外部表象中得出关于内部状态和能力的错误假设,目的是提取出一个人的更多信息,而不是他们选择揭示的信息。

世界各国在开发治疗人体的药物时都有严格的科学规定。那些宣称我们的思想的工具至少应该得到同样的保护。多年来,学者们一直呼吁联邦实体监管机器人和面部识别;这也应该延伸到情感识别。现在是国家监管机构防范未经证实的申请的时候了,特别是那些针对儿童和其他弱势群体的申请。

临床试验的教训表明了为什么监管是重要的。联邦要求和随后的宣传使更多的临床试验数据向公众开放,并经过严格的验证。这成为更好的政策制定和公众信任的基础。对情感技术的监管也会带来类似的好处和责任。它还有助于建立规范,以对抗企业和政府的越权行为。

测谎仪是一个有用的例子。这种“测谎仪”测试发明于20世纪20年代,被联邦调查局和美国军方使用了几十年,结果前后不一致,伤害了数千人,直到联邦法律禁止使用。直到1998年,美国最高法院才得出结论:“对于测谎证据是否可靠,人们根本没有共识。”

但埃克曼描述的六种情绪完全符合新兴的计算机视觉领域的模型。他的理论之所以被采纳,是因为它符合工具的功能。只要忽略更复杂的问题,六种一致的情绪就可以大规模标准化和自动化。2001年9月11日恐怖袭击后,埃克曼将他的系统卖给了美国运输安全管理局,以评估哪些乘客表现出恐惧或紧张,以及可能是恐怖分子。它因缺乏信誉和种族偏见而受到强烈批评。然而,今天的许多工具,如“四棵小树”,都是基于埃克曼的六种情绪分类。(埃克曼坚称,面部表情确实传达了普遍的情绪,但他表示,他没有看到自动化技术有效的证据。)

然而,公司继续销售的软件,将影响人们的机会,没有清楚地记录,独立审计的证据的有效性。求职者受到不公平的评判,因为他们的面部表情或声调与员工不匹配;学生们在学校被标记,因为他们的脸看起来很生气。研究人员还表明,面部识别软件认为黑人面孔比白人面孔有更多的负面情绪。

不能再允许情绪识别技术不受监管。现在应该采取立法保护措施,防止在教育、保健、就业和刑事司法等所有领域未经证实地使用这些工具。这些保护措施将重新聚焦严格的科学,并拒绝内部状态只是另一个数据集,可以从我们的脸上刮走。

原文出处

本网站所有内容来源注明为“梅斯医学”或“MedSci原创”的文字、图片和音视频资料,版权均属于梅斯医学所有。非经授权,任何媒体、网站或个人不得转载,授权转载时须注明来源为“梅斯医学”。其它来源的文章系转载文章,或“梅斯号”自媒体发布的文章,仅系出于传递更多信息之目的,本站仅负责审核内容合规,其内容不代表本站立场,本站不负责内容的准确性和版权。如果存在侵权、或不希望被转载的媒体或个人可与我们联系,我们将立即进行删除处理。

在此留言

#Nat#

49

哈哈

91