分割一切的视觉算法出现,病理和影像的人工智能可能会被颠覆!

2023-04-10 网络 网络 发表于上海

Meta研究部门发布了一篇名为其“Segment Anything(分割一切)”的论文,文中介绍了一个全新的Segment Anything Model(即SAM),可以用于识

Meta研究部门发布了一篇名为其“Segment Anything(分割一切)”的论文,文中介绍了一个全新的Segment Anything Model(即SAM),可以用于识别图像和视频中的物体,甚至是人工智能从未被训练过的物品。

所谓的“分割”,用最通俗的话来说就是抠图。但Meta此次所展示的人工智能抠图能力,可能远比你想象的要更加强大,甚至在人工智能领域被认为是计算机视觉的“GPT-3时刻”。

此次SAM的一大突破还在于即使是在训练过程中从未遇到过的物品和形状,人工智能也能将其准确识别并分割出来。

英伟达人工智能科学家 Jim Fan 表示此次SAM最大的一点突破是它已经基本能够理解“物品”的一般概念,即使对于未知对象、不熟悉的场景(例如水下和显微镜里的细胞)它都能比较准确的理解。因此他表示相信SAM的出现会是在计算机视觉领域里的GPT-3时刻。

不仅是Jim有这样的观点,一些AI研究专家甚至也表示,SAM之于计算机视觉,就像是GPT之于大语言模型。

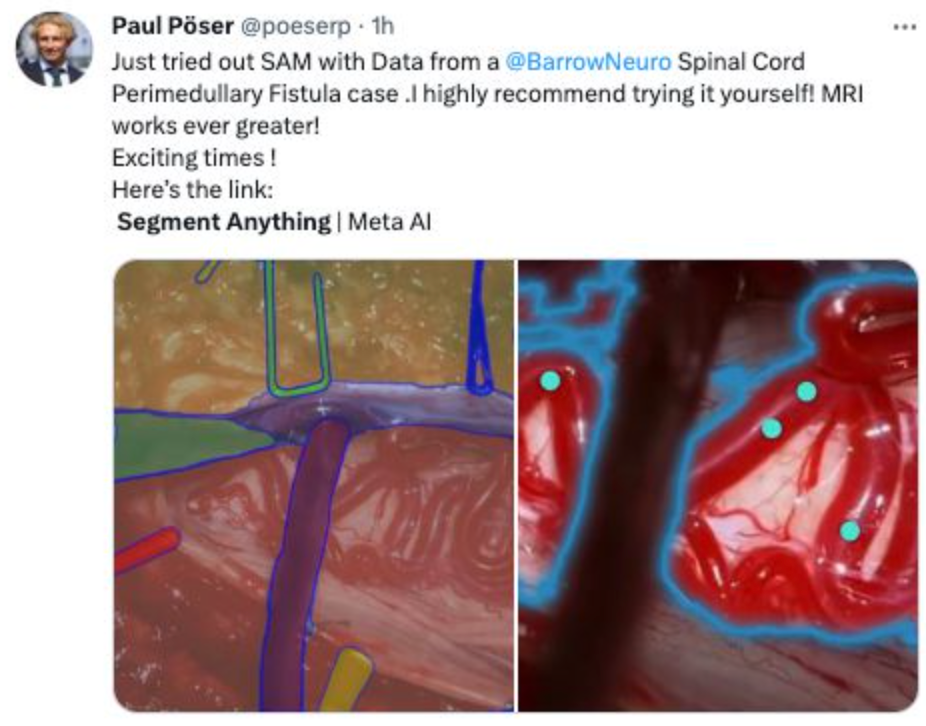

有神经外科影像学的专家将SAM用到了一个脊髓血管病的病例文件之中,认为SAM在帮助判断和分析病情上有很大帮助。

有生物学家输入了一张显微镜下的组织图片,即使图中形状特征毫无规律,但凭借着Zero-shot技术,SAM也能够自动识别多细胞结构中的腺体、导管、动脉等。该生物学家认为SAM的产出结果已经非常接近完美,未来能够节省大量手动注释的时间。

几乎同时,国内的智源研究院视觉团队也提出了通用分割模型SegGPT——Segment Everything in Context,首个利用视觉上下文完成各种分割任务的通用视觉模型。

SegGPT “一通百通”:可使用一个或几个示例图片和对应的掩码即可分割大量测试图片。用户在画面上标注识别一类物体,即可批量化识别分割出其他所有同类物体,无论是在当前画面还是其他画面或视频环境中。

SAM“一触即通”:通过一个点、边界框或一句话,在待预测图片上给出交互提示,识别分割画面上的指定物体。这也就意味着,SAM的精细标注能力,与SegGPT的批量化标注分割能力,还能进一步相结合,产生全新的CV应用。

参考资料:

https://research.facebook.com/publications/segment-anything/

论文地址:https://arxiv.org/abs/2304.02643

论文地址:https://arxiv.org/abs/2211.07636

代码地址:https://github.com/baaivision/Painter

Demo:https://huggingface.co/spaces/BAAI/SegGPT

本网站所有内容来源注明为“梅斯医学”或“MedSci原创”的文字、图片和音视频资料,版权均属于梅斯医学所有。非经授权,任何媒体、网站或个人不得转载,授权转载时须注明来源为“梅斯医学”。其它来源的文章系转载文章,或“梅斯号”自媒体发布的文章,仅系出于传递更多信息之目的,本站仅负责审核内容合规,其内容不代表本站立场,本站不负责内容的准确性和版权。如果存在侵权、或不希望被转载的媒体或个人可与我们联系,我们将立即进行删除处理。

在此留言

新技术不断涌现

71

#视觉算法#

75